Configurer la sécurité des assistants vocaux IA : Le Guide Complet

Les assistants vocaux (Alexa, Google Home, Siri, HomePod…) ont envahi les foyers français. Ils facilitent la vie : rappels, musique, météo, veilleuse pour les enfants, pilotage des objets connectés…

Mais ils sont aussi devenus une porte d’entrée trop souvent négligée pour les cyberattaques domestiques.

Par défaut, ces appareils écoutent, collectent, enregistrent, et parfois partagent plus d’informations qu’on ne le pense.

Pour une famille, ces données peuvent révéler des habitudes de vie, des horaires, des voix d’enfants : des éléments sensibles qui doivent être protégés.

Dans cet article, vous découvrirez les 7 réglages indispensables pour la sécurité des assistants vocaux IA familiaux en quelques minutes.

Pourquoi protéger un assistant vocal familial ?

Un assistant vocal peut exposer une famille à plusieurs risques :

1. L’écoute non voulue et l’enregistrement permanent

Même lorsqu’il semble “en veille”, l’appareil capte des mots déclencheurs. Des enregistrements peuvent être sauvegardés et analysés.

2. Le risque d’achats involontaires (enfant / pirate)

Un enfant peut commander un jouet sans le vouloir… mais un pirate à proximité peut aussi faire la même chose.

3. Le contrôle des appareils connectés

Si quelqu’un prend le contrôle vocal, il peut :

-

déverrouiller une porte connectée,

-

désactiver une caméra,

-

lancer une vidéo inappropriée,

-

modifier des réglages sensibles.

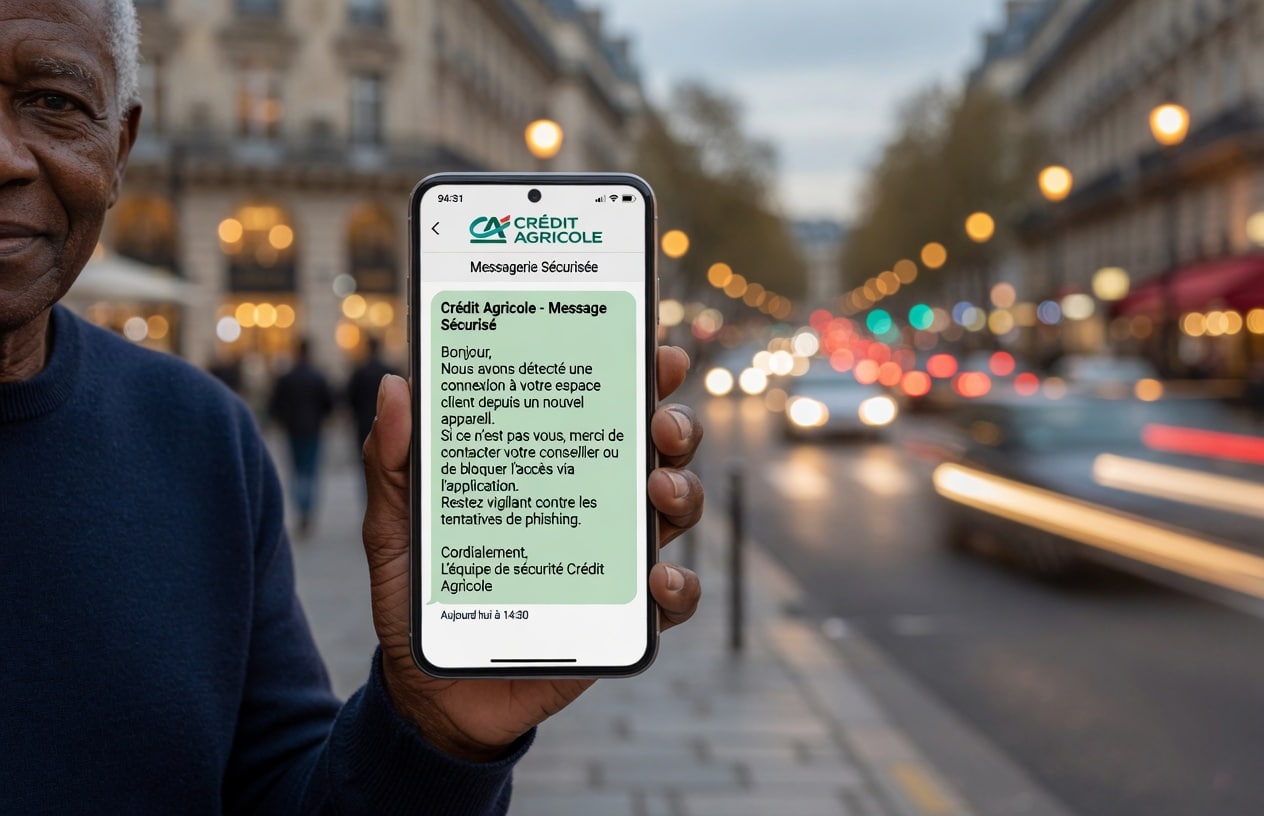

4. Le clonage de voix

Les assistants enregistrent la voix des membres de la famille.

Dans un contexte d’arnaques vocales IA, c’est un élément à protéger.

Les 7 réglages indispensables pour la sécurité des assistants vocaux IA en famille

Voici les réglages prioritaires, applicables sur Alexa, Google ou Siri.

1. Désactiver les achats vocaux ou les protéger par un code

Les achats vocaux sont l’une des fonctions les plus risquées pour les familles.

Alexa

-

Ouvrez l’application Alexa

-

→ Paramètres

-

→ Paramètres du compte

-

→ Achats vocaux

-

Désactivez OU activez la confirmation par code vocal

Pourquoi c’est indispensable

-

Empêche un enfant d’acheter sans le vouloir

-

Empêche un pirate à proximité d’effectuer des commandes frauduleuses

-

Évite les tests “drôles” de visiteurs ou d’amis

2. Désactiver les enregistrements ou limiter la conservation

Les assistants vocaux stockent de nombreux extraits de vie familiale.

Bonne pratique

-

Désactiver l’enregistrement de l’historique

ou -

Le supprimer automatiquement tous les 3 mois

Alexa, Google et Apple offrent ce réglage.

Pourquoi le faire

-

Réduit le risque de compromission de données

-

Empêche la récupération d’enregistrements de voix d’enfants

-

Limite le profilage publicitaire

3. Créer un profil vocal pour chaque membre de la famille

La plupart des assistants permettent d’associer une “empreinte vocale” à chaque personne.

Les avantages

-

L’appareil reconnaît les voix des enfants → limite les actions non autorisées

-

Les enfants ne peuvent plus envoyer de messages, passer des commandes, ou accéder à des contenus adultes

-

Le contrôle parental devient beaucoup plus précis

Conseil

Enregistrer la voix dans un environnement calme pour éviter les erreurs de reconnaissance.

4. Activer le mode “confidentialité renforcée” ou “mute physique”

Chaque enceinte vocal possède un bouton coupure microphone.

À utiliser dans ces cas :

-

Réunions sensibles

-

Conversations familiales privées

-

Lecture d’informations bancaires

-

Discussion avec un professionnel de santé

Avantage clé

Cela empêche toute écoute, même accidentelle.

5. Sécuriser le réseau Wi-Fi de la maison

Un assistant vocal ne peut être sécurisé que si votre réseau l’est aussi.

Les réglages essentiels

-

Activer le chiffrement WPA3

-

Changer le mot de passe Wi-Fi par un code long et unique

-

Séparer un réseau Wi-Fi invités pour les appareils des enfants ou visiteurs

-

Mettre à jour la box internet régulièrement

Résultat

Même si quelqu’un piratait un appareil de la maison, il ne pourrait pas accéder directement à l’assistant vocal.

6. Désactiver les fonctionnalités inutiles

Moins de fonctions = surface d’attaque réduite.

Sur Alexa / Google Home, pensez à désactiver :

-

les appels sortants

-

les routines sensibles

-

les commandes de serrures ou de caméras

-

la géolocalisation

-

l’accès au calendrier ou aux emails

-

la lecture de messages ou notifications sensibles

Pourquoi c’est important

Si une personne parvient à lancer une commande vocale depuis l’extérieur (fenêtre ouverte, balcon, interphone…), elle aura un impact limité.

7. Créer une règle familiale simple face aux commandes suspectes

Une famille doit établir une ligne directrice :

“On ne fait jamais confiance à une commande vocale inattendue.”

Assistant Vocal : Les bons réflexes à enseigner aux enfants

Assistant Vocal : Les bons réflexes à enseigner aux enfants

-

L’assistant ne doit jamais être utilisé pour envoyer des messages

-

On ne donne jamais de codes, adresses, informations personnelles

-

Si une commande semble bizarre → prévenir un adulte

-

Ne jamais obéir à une voix inconnue

Bonus : utiliser un mot de sécurité

Un mot secret utile pour différencier un vrai papa / maman et une imitation IA (scénario d’arnaques vocales).

Sécurité des assistants vocaux IA : Comment en parler aux enfants ? (

Les enfants peuvent avoir du mal à comprendre les risques. Voici une façon simple d’aborder le sujet.

1. Expliquer avec des mots simples

“L’assistant vocal t’aide, mais parfois il peut mal comprendre. Il ne faut jamais lui faire confiance pour les choses importantes.”

2. Donner des règles très concrètes

-

“Tu ne commandes rien avec l’enceinte.”

-

“Tu ne lui donnes pas d’informations personnelles.”

-

“Si une voix inconnue parle, tu m’appelles.”

3. Vérifier ensemble les réglages

Impliquer les enfants les responsabilise et les rassure.

Checklist : votre assistant vocal est-il sécurisé ?

Cochez mentalement :

-

Achats vocaux désactivés ou protégés

-

Enregistrements limités ou supprimés régulièrement

-

Mode mute connu et utilisé

-

Wi-Fi sécurisé (WPA3 + mot de passe fort)

-

Fonctions inutiles désactivées

-

Règles familiales établies

Si vous avez 6 cases sur 7 → Bravo votre assistant vocal est bien protégé.

Avec 7/7 → Excellent niveau de sécurité numérique familiale.